Para esta ocasión, Nvidia AI recibe varios cambios para sus sistemas de habla, de recomencación, inferencia de hiperescala y mucho más.

Esta noticia viene acompañada de un anuncio, el programa de Aceleración de IA con NVIDIA. Con esto buscan garantizar el rendimiento y la confiabilidad de las aplicaciones de IA desarrolladas por los socios de software. Aumenta la visibilidad a una amplia gama de aplicaciones comprobadas y aceleradas por IA, permitiendo implementaciones confiables en la plataforma. Adobe, Red Hat y VMware se encuentran entre los más de 100 socios participantes en el lanzamiento.

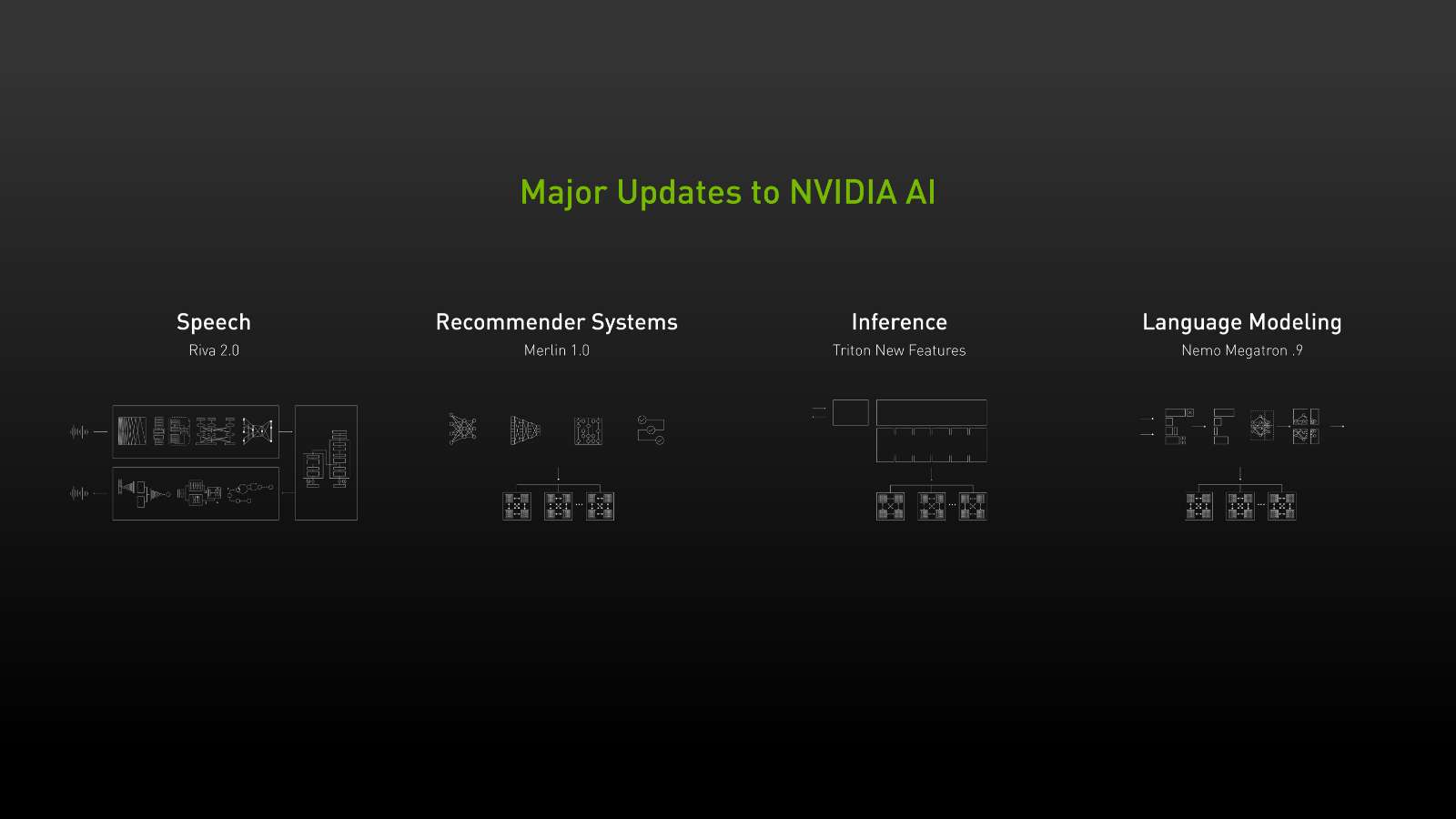

Nvidia AI recibe un acceso gratuito para los desarrolladores e incluye NVIDIA Riva y NVIDIA Merlin. El primero está pensando para la IA de voz, mientras que el segundo sirve para las recomendaciones inteligentes. También se han realizado actualizaciones a herramientas como NVIDIA Triton, NeMo, Maxine y el Kit de Herramientas TAO. Además NVIDIA AI Enterprise 2.0 está certificado y es compatible con los centros de datos y plataformas en la nube. La suite ahora es compatible con Red Hat OpenShift y VMware vSphere con Tanzu.

Nvidia AI recibe un acceso gratuito para los desarrolladores e incluye NVIDIA Riva y NVIDIA Merlin. El primero está pensando para la IA de voz, mientras que el segundo sirve para las recomendaciones inteligentes. También se han realizado actualizaciones a herramientas como NVIDIA Triton, NeMo, Maxine y el Kit de Herramientas TAO. Además NVIDIA AI Enterprise 2.0 está certificado y es compatible con los centros de datos y plataformas en la nube. La suite ahora es compatible con Red Hat OpenShift y VMware vSphere con Tanzu.

Algunas herramientas que componen el set:

- Triton como versátil de inferencia de modelos de hiperescala de código abierto. Tiene un Navegador de Modelos para la implementación acelerada de modelos optimizados. El Servicio de Administración para escalar de forma eficiente en Kubernetes. Finalmente la Biblioteca de Inferencia de Bosque que permite la inferencia en modelos basados en árboles.

- RIVA 2.0 ofrece un un SDK de IA de habla de clase mundial, previamente entrenado con tasas de reconocimiento líderes.

- NeMo Megratron 0.9 tiene framework más rápido para el entrenamiento de grandes modelos de idiomas (LLM). Permite a los investigadores y empresas entrenar cualquier modelo para la convergencia y escalar a trillones de parámetros.